2025年是智算建设热潮兴起的第三年。

今年初,DeepSeek横空出世后,市场上一度掀起一波有关智算中心建设和算力需求是否还需要高投入的大讨论。

有观点认为,DeepSeek采取的限定算力卡技术路径,使得算力的投入不再像2023年和2024年那样高昂。但也有观点指出,智算需求仍将保持高位。

半年过去,智算中心市场如何演进,到底发生了哪些变化?

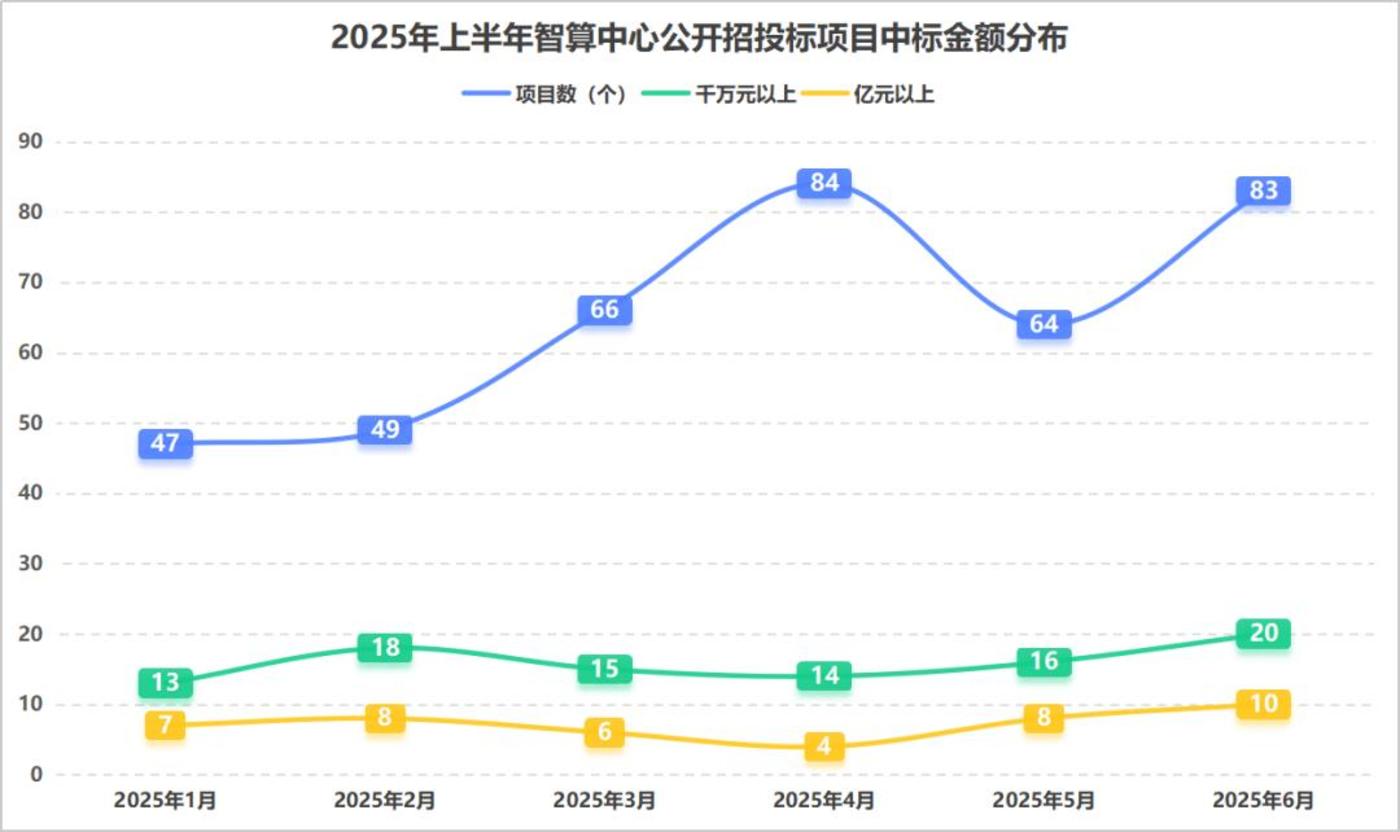

最近,通过中国政府采购网、中国招投标公共服务平台、天眼查、企查查、寻标宝等公开渠道梳理发现,2025年上半年的公开招投标市场上,围绕土建基础设施和IT基础架构等方方面面的建设内容,国内智算中心相关项目中标公告已发布近400个。智算中心建设热潮依旧,项目数、建设规模与中标金额均再创新高,上半年涌现超40个亿元大单。

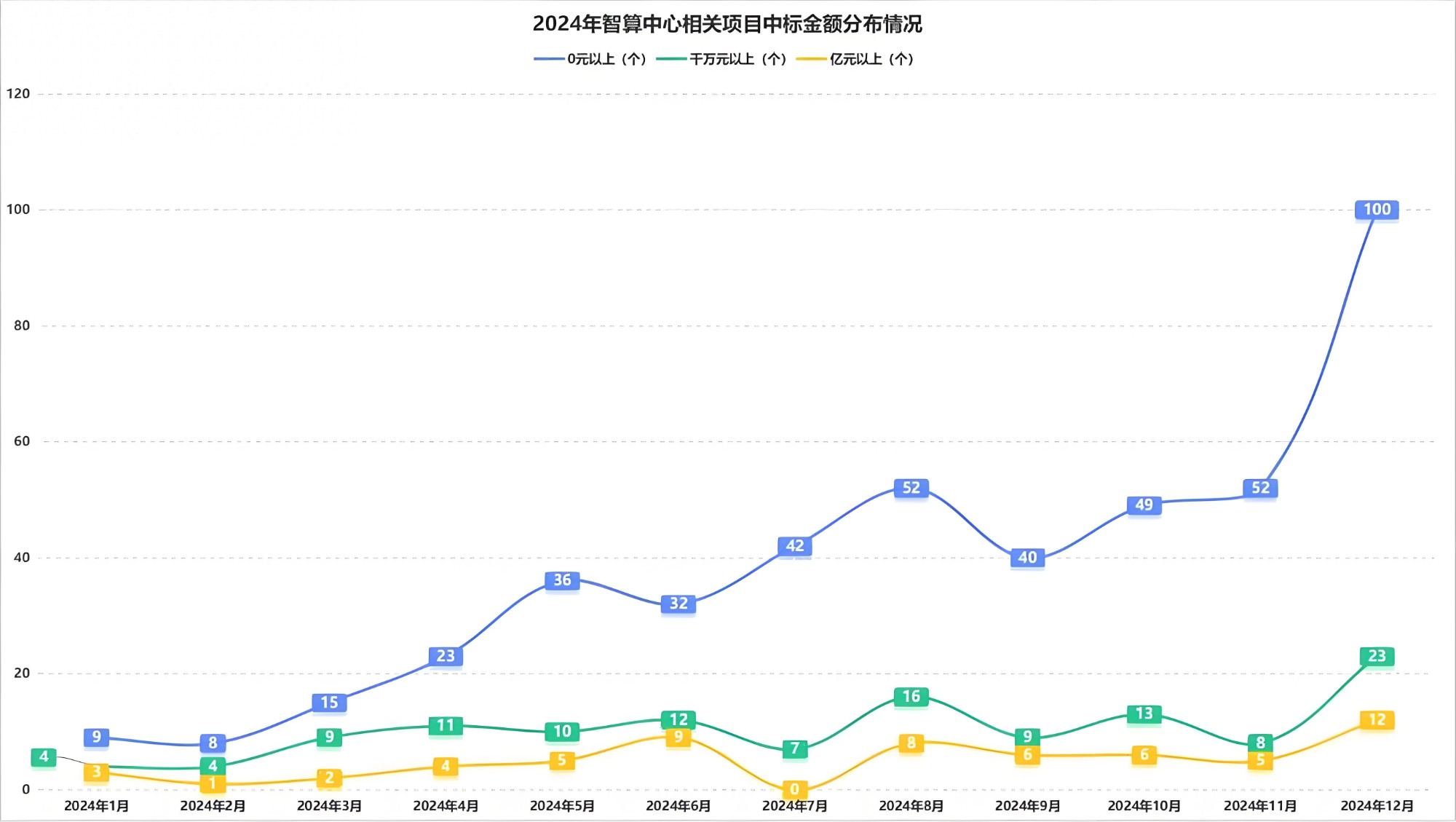

2024年全年智算中心相关公开中标项目458个

2025年上半年智算中心相关公开中标项目393个

6月中旬的一场ICT市场趋势论坛上,IDC的一个观察——今年一季度,在DeepSeek刺激下,市场非但没有降低对算力的需求,反而增速超出预期。

基于杰文斯悖论,当技术进步提高了某种资源的使用效率后,非但不会减少该资源的总体消耗量,反而可能导致其总需求增加。当DeepSeek降低AI训练成本后,更多企业接入AI开发,推理需求暴增,导致算力消耗指数级增长,反而促进市场需求大爆发。

这场由DeepSeek等大模型技术引爆的算力革命,正驱动智算中心从技术概念蜕变为数字经济核心基础设施。

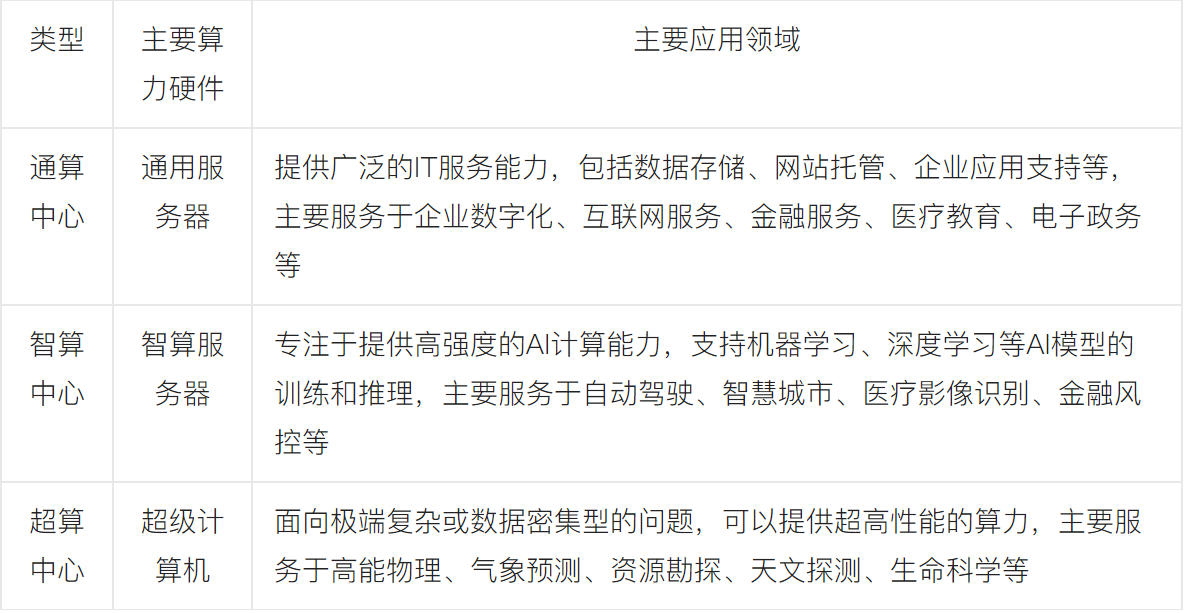

智算中心,就是以人工智能计算任务为主的数据中心。

数据中心通常包括三种类别,除了智算中心以外,另外两种分别是以通用计算任务为主的通算中心,以及以超级计算任务为主的超算中心。

2023年以来,以ChatGPT、Sora为代表的AIGC大模型横空出世,掀起了一股席卷全球的AI浪潮。

想要在AI浪潮中占据优势,就必须拥有强劲的AI算力支撑。智算中心,作为AI算力的核心基础设施,逐渐成为人们关注的焦点,也是行业重点建设的对象。

这些智算中心采用专门的AI算力硬件,适合高效运行AI算法。它们可以应用于计算机视觉、自然语言处理、机器学习等领域,处理图像识别、语音识别、文本分析、模型训练推理等任务。

智算服务器是智算中心的主要算力硬件。它和传统通用服务器最大的区别,在于算力芯片的不同。

传统通用服务器以CPU作为主要芯片,有的配置了GPU(图形处理单元)卡,也有的没配。即便配置了,也数量不多(1-2块),以完成传统图形处理任务(3D图形渲染等)为主。

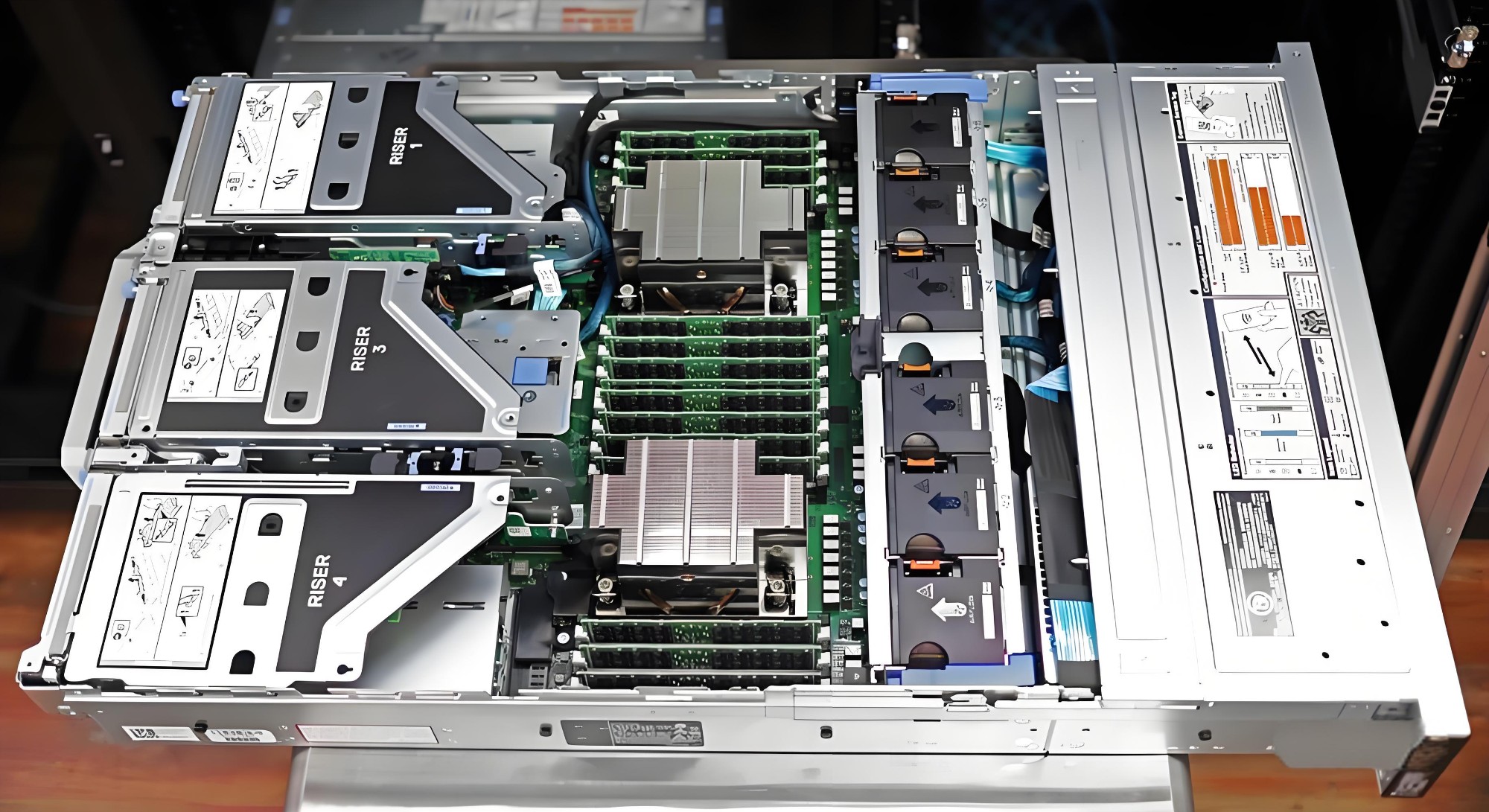

Dell R750 基于Intel CPU 的双处理器服务器

智算服务器,为了保证的操作系统运行,也配置了CPU。但是,为了更好地完成AI计算任务,所以配置了更多的GPU、NPU(神经网络处理单元)、TPU(张量处理单元)等计算芯片(4块或8块),以这些芯片输出的算力为主。

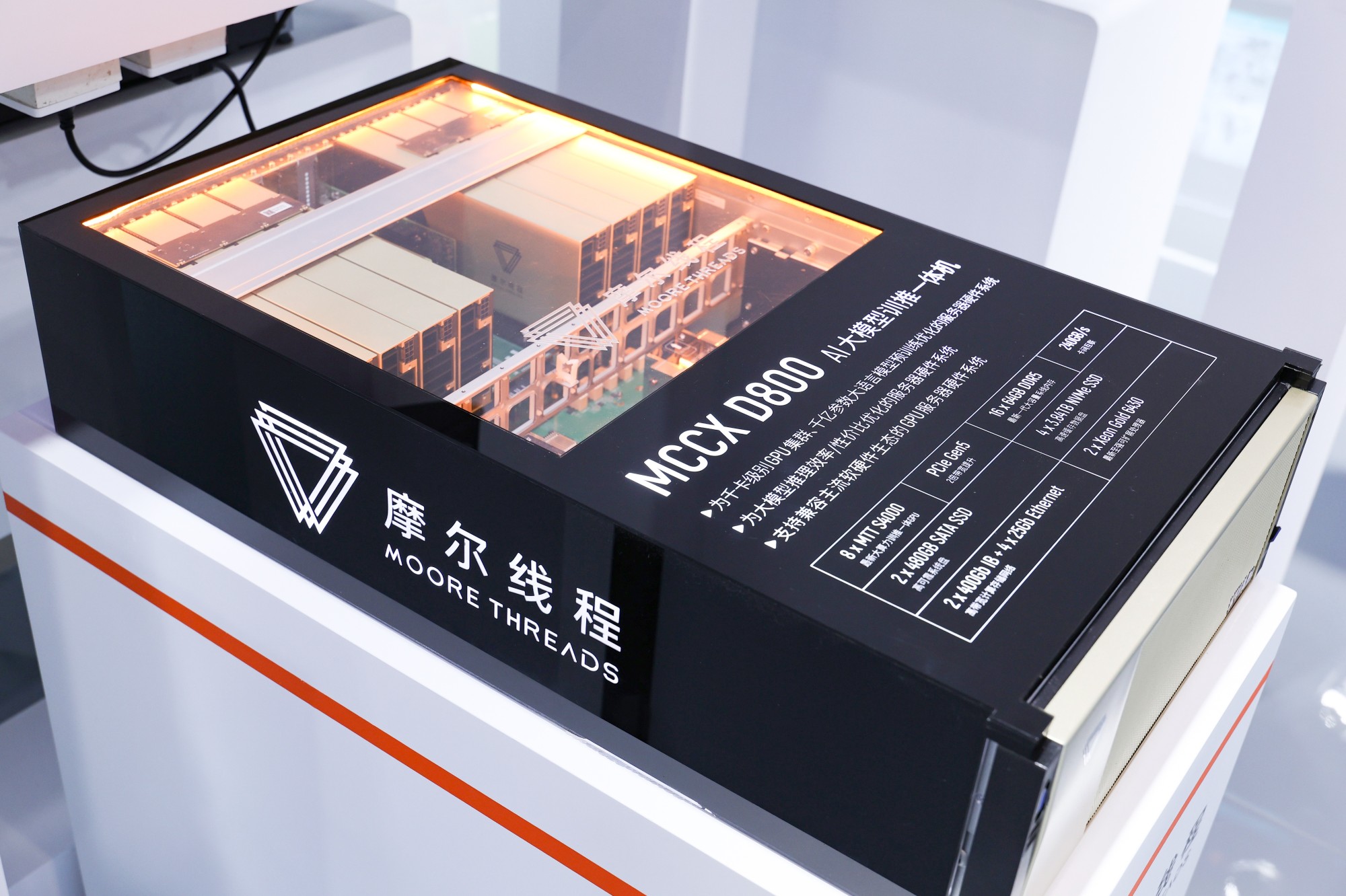

国产8路“摩尔线程”S4000智算服务器

8路英伟达H200智算服务器

8路英伟达H200智算服务器

这种“CPU+GPU”、“CPU+NPU”的架构,也被称为“异构计算”架构,能够充分发挥不同算力芯片在性能、成本和能耗上的优势。

GPU、NPU、TPU的内核数量多,擅长并行计算。AI算法涉及到大量的简单矩阵运算任务,需要强大的并行计算能力。

在实际使用中,GPU、NPU、TPU会做成板卡的形态,插入到智算服务器的插槽中。等服务器上电启动后,再根据调度执行计算任务。

除了芯片不同之外,为了充分发挥性能以及保障稳定运行,AI服务器在架构、存储、散热、拓扑等方面也进行了强化设计。

疯狂的堆料,肯定也会带来两者之间的成本差异。一台智算服务器的价格,可能会达到传统通用服务器的数十倍以上。

不久前,中国移动公示了2024年至2025年新型智算中心集采中标结果,采购智算服务器总规模达到8054台,中标总金额达到了约191.04亿元人民币(不含税)。平均下来,每台的价格是237.2万元。通用服务器的价格,根据品牌和配置的不同,大约在1到10万元之间。

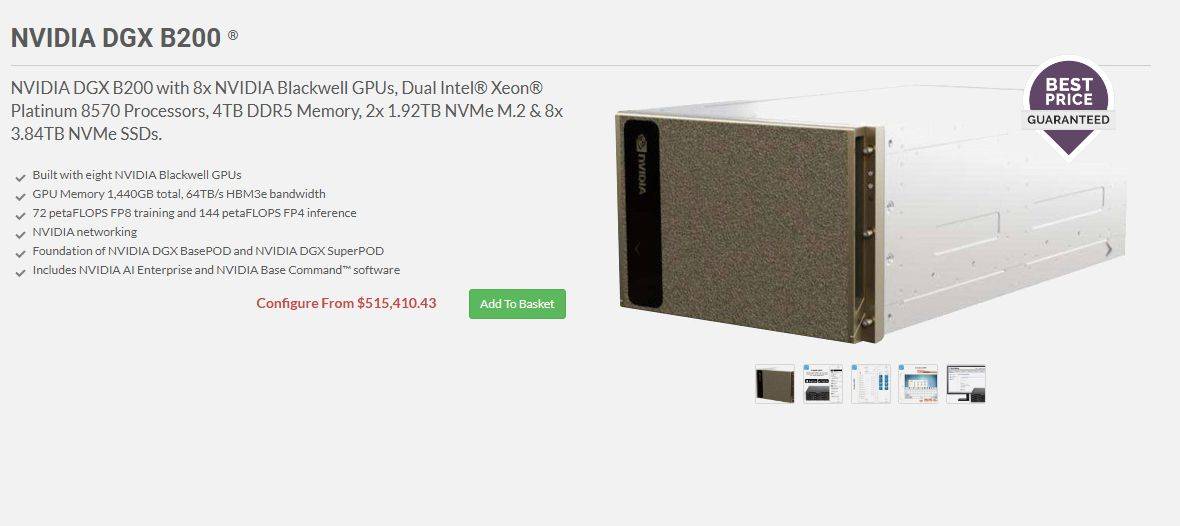

最新的NVIDIA DGX B200 AI服务器(标价高达515410美元,折合人民币约369.4万元)

受算力板卡的影响,智算服务器的功耗也明显大于通用服务器。

以英伟达GPU为例,A100单卡功耗400W,H100单卡功耗700W。配置了8张GPU的智算服务器,仅GPU的热功耗就能达到3.2~5.6 kW。传统通用服务器的话,也就0.3~0.5 kW左右。

较高的功率,使水冷成为智算服务区较好的散热解决方案,成本也相对提升

从外型上来看,智算服务器和通用服务器并没有很大的区别。两者都是标准架构,可以放入42U标准机架。如果内置了较多的AI算力板卡,智算服务器的厚度可能会稍微大一些,达到4U、5U甚至10U。

这里需要注意,根据工作任务的不同,智算服务器也会分为训练服务器、推理服务器或者训推一体服务器。这些服务器在架构和体型上会存在一些差异。一般来说,训练服务器会比推理服务器更庞大一些(AI算力板卡更多)。

2024年,中国智能算力规模达725.3EFLOPS,同比增长74.1%,增幅是通用算力的3倍以上。据预测,2025年将突破1037.3EFLOPS,2026年更将攀升至1460.3EFLOPS,实现两年翻倍。

这一爆发式增长源于AI技术的根本需求:Gartner预测,2025年将成为AI普及化的关键拐点——推理算力规模将首次超过训练算力,到2028年,推理服务器将占据整个市场的70%。

在此背景下,AI大模型训练、自动驾驶、智慧城市等场景对智能算力的需求呈指数级上升,高性能服务器、智算中心等基础设施成为行业“刚需”。

在技术和行业的双重驱动下,未来的算力设施将通过三方面特点的呈现:

首先,算力多样性态势日益凸显。作为新一轮技术革命的衍生品,数据资源正在以极低的边际成本加速涌现。这些数据资源既可以与新材料技术、先进制造技术相结合,也可以作为独立生产资料存在,从生产、管理、计算、交流等多方面赋能企业经营,成为新的关键生产要素。

在此背景下,没有任何一种计算架构可以满足所有行业诉求,围绕数据分析处理的算力被赋予更加丰富的内涵,在基础通用算力之外,诞生了智能算力、超算算力以及前沿算力(如量子计算、光子计算)等专业化的算力设施。

其次,算力布局呈现泛在化趋势。算力资源从集中的部署方式,正在往多级化的方向发展,尤其是以边缘计算、端计算为代表的算力形态的出现,与规模化算力形成互补之势,构建新型的云计算基础设施,成为各行各业转型升级的数字底座。

同时,供需剪刀差、分布不均衡、使用效率低等问题亟需全社会算力集约化发展,算力网络化技术将整合不同归属、不同地域、不同架构的算力资源,打破数据孤岛,推动数字经济走向繁荣。

第三,智能敏捷、绿色安全将成算力发展新要求。算力智能化、算力绿色化、算力可信化成为未来发展方向。伴随数字世界和物理世界的边界逐步消融,人工智能将从无人驾驶、工业互联网等上层应用向底层基础设施蔓延,智能敏捷、随愿自治将成为智能社会算力设施的重要标签。

面向未来,AI基础设施将面临“三重平衡”的持续挑战:算力增长与能耗控制的平衡、算力成本与投入回报的平衡、硬件迭代与生态兼容的平衡。

AI的狂飙突进,本质上是一场算力的革命。从全球科技巨头动辄数千亿美元的基建投入,到中国智算规模的跨越式增长,从训练推理的指数级算力需求,到物理AI对现实世界的深度渗透,算力已不仅是技术迭代的基石,更成为衡量国家竞争力的核心指标,“算力即国力”已成为全球科技竞争的共识。

当AI大模型从技术狂热步入价值创造深水区,智算中心正从集中式资源蜕变为泛在化生产力。中国智能算力规模将在两年内翻越1460EFLOPS峰值的预测,折射出一个国家在数字文明时代对核心生产力的重构决心。

这场静默的算力革命正在重构经济地理:贵州深山的数据集群驱动着《哪吒2》的影像渲染,上海临港的“算力迁徙”平衡着千里之外的电力负荷,宁夏灵武的液冷系统降低着每一焦耳的碳足迹。

随着全国算力互联互通体系加速构建,“所想即所得”的算力服务将成为数字经济的神经中枢。当千行百业的智能化转型从实验室走向生产线,智算中心铸就的算力脊梁,终将支撑起一个智能时代的到来。

声明:本文相关资料来源于互联网公开数据或文章,经搜集整理而成。若涉及侵权问题,请相关权利人及时与作者联系,作者将在核实后第一时间予以删除 ,以维护权利人的合法权益。

Copyright ©2023黑龙江振宁科技股份有限公司版权所有 黑ICP备17006788号 | 黑公网安备